Sprache ist ein fesselndes Instrument, das durch die richtigen Wörter Massen einwickeln und Bedeutungen unterscheidbar machen kann. Das hat der Schauspieler Benedict Cumbrebatch in dem Film The Imitation Game (Morten Tyldum, 2014) in seiner Rolle als Mathematiker Alan Turing (1912-1954) wunderbar bewiesen. Der Film handelt von den gesellschaftlichen Problemen, die dadurch entstehen, dass die Codes der von den Nazis im zweiten Weltkrieg zur Verschlüsselung vertraulicher Botschaften entwickelten Enigma-Maschinen geknackt werden. Turing entschlüsselt diese Botschaften und stellt zu seiner Überraschung fest, dass die Maschinen auf eine Art Entscheidungen treffen, die der Entscheidungsfähigkeit des Menschen sehr nahe kommt.

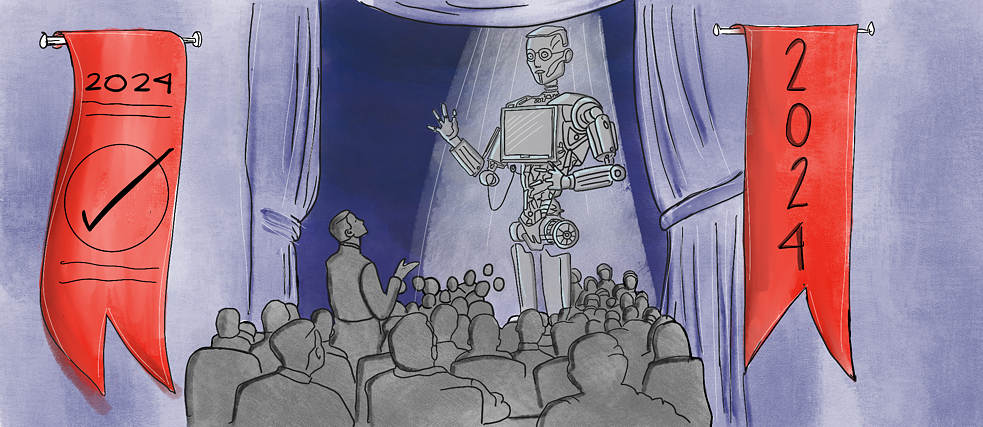

In der Folge sollte erforscht werden, inwieweit Maschinen mit unserem freien Willen konkurrieren können. 1950 erdachte Turing einen Test, um zu untersuchen, ob Computer ein mit menschlicher Intelligenz vergleichbares Denkvermögen haben. Beim sogenannten Turing-Test wird untersucht, ob sich eine Maschine in einer Unterhaltung ebenso intelligent verhalten kann wie ein Mensch. Nach Alan Turing bestand die Maschine den Test dann, wenn ein Prüfer in einer schriftlichen Kommunikation nicht zwischen der Maschine und dem Menschen unterscheiden konnte. In den letzten Jahren hat das Leben der Simulation Tür und Tor geöffnet, und das wirft diverse Fragen zu unseren demokratischen Prozessen auf.

Ich kann mich erinnern, dass Anfang 2000 Videospiele wie Die Sims damit begannen, mit Avataren und simulierten Entscheidungen zu experimentieren. Hier stellt sich die Frage: Was geschieht, wenn es in den digitalen Realitäten nachahmenswerte Modelle gibt, die die Fähigkeit besitzen, auch über den Bildschirm hinaus Einfluss auszuüben? Reicht es aus, dass wir uns verstanden fühlen, um unsere Urteile und Werte abzuändern?

Eine weiter gefasste Betrachtung zeigt, dass zwischen künstlicher Intelligenz (KI) und Demokratie ein Spannungsfeld entstehen kann, vor allem, wenn man sich überlegt, dass die Algorithmen, die beim Treffen demokratischer Entscheidungen verwendet werden, von externen Stellen erstellt und angepasst werden können. Durch die fehlende Transparenz darüber, wie diese Algorithmen genutzt werden, kann das Vertrauen der Öffentlichkeit untergraben werden. Das kollektive Denken und die öffentliche Meinung werden aber entscheidend von Überzeugungsreden geformt, und Standpunkte werden permanent debattiert, weil es an Wissen fehlt und weil keine unterschiedlichen Perspektiven beleuchtet werden.

Laut Experten des Massachusetts Institute of Tecnology (MIT) sollten der öffentliche Sektor und Regierungsstellen in Betracht ziehen, Tools wie Chatbot oder Chat GPT einzusetzen. Außerdem wird vorgeschlagen, im Metaversum geschaffene Avatare zum Management von Gemeinschaften heranzuziehen. Dadurch würde ein autonomer Lernprozess entstehen, die öffentliche Debatte würde belebt und es würde eine direkte Entscheidungsfindung ohne den Einfluss von Interessen von Konzernen oder Monopolen ermöglicht.

DIGITALER POPULISMUS

Das Wort “Deepfake” gibt Aufschluss über die Lügen, die Videos zugrunde liegen, die zwar fiktiv sind, dank der Manipulation durch KI-Applikationen aber überraschend echt wirken. So schnell falsche Inhalte verbreitet werden, so langsam geht die Entwicklung effizienter Tools zu ihrer Aufdeckung voran. Die fehlenden Regularien zu Bildrechten machen das Phänomen noch ein großes Stück komplexer.Die permanente Herausforderung, uns dem „Turing-Test“ zu unterziehen, ist darin begründet, dass manche KI-Formate Bilder und Stimmen so aufbereiten, dass sie fast nicht von der Wirklichkeit zu unterscheiden sind. Diese Darstellungen können wie Zerrspiegel Botschaften mit versteckten Absichten verbreiten. Deepfake ist ein präzises Handwerk zur Manipulation von Emotionen und bedient sich unterschwelliger Botschaften, die Gefühle wie Scham, Mitleid, Missfallen, Melancholie, Ablehnung oder Anbetung wecken.

Dieses Phänomen fordert unser emotionales Unterscheidungsvermögen heraus, denn selbst wenn die Videos künstlich erstellt werden, vermögen sie doch echte emotionale Reaktionen hervorzurufen. Das Gemeinschaftsgefühl, das in virtuellen Dialogen aufgebaut wird, kann fiktive Figuren oder solche ohne eigenes Denkvermögen in Machtpositionen bringen. Aus philosophischer Sichtweise heraus ist es zwar verständlich, dass die Neigung besteht, an etwas Höheres zu glauben, dennoch erlangt eine reflektierende Analyse zentrale Bedeutung, wenn es um den Diskurs kurzlebiger populärer Figuren geht.

Die Gesellschaft gewöhnt sich an bestimmte Verhaltensweisen und beginnt daher, die Defizite dieser populären Figuren offensichtlich zu machen. Manche Führungspersönlichkeiten jüngerer Zeit zeichnen sich durch ihre Ausstrahlung aus, während andere wegen ihrer falschen Entscheidungen in Erinnerung bleiben. Der digitale Populismus richtet sich darauf aus, Figuren anzubeten und zu unterstützen, die ausschließlich von sozialen Netzwerken oder massiver Interaktion geschaffen wurden. Dadurch wird ein politisches System befördert, in dem Wahrheitstreue und Vertrauen nur schwer überprüft werden können. In diesem Zusammenhang beschränkt sich die Politik nicht mehr darauf, in kleinem Rahmen Einfluss zu nehmen – die Einflussnahme reicht bis zur Regierung ganzer Nationen. In unserer Verantwortung liegt es, nicht zu leeren Mitteln wie Polemik, Narzissmus oder Radikalität zu greifen wie Javier Milei in Argentinien, dessen Reden auf die Ultrarechte abzielen auf der Suche nach Wählern, die ihn zum Staatspräsidenten machen sollen.

Diese Überlegung macht deutlich, dass Führungspersönlichkeiten die Bevölkerung zusammenhalten müssen, indem mit einer authentischen Sprache die Wahrheit gesagt wird. In diesem Zusammenhang ist das Deepfake-Phänomen ein aussagekräftiges Beispiel dafür, wie mit einem geschickten Gleichgewicht zwischen Bild und Ton Eigeninteressen verfolgt werden können. Mitten im Jahre 2023 erleben wir also eine neue Version des Turing-Tests, die unser Empfindungs- und Denkvermögen auf die Probe stellt, da die Grenzen zwischen Fiktion und Wirklichkeit überschritten werden.

Die Europäische Union erkennt an, dass diese Videos potenziale Tools für Desinformation sind. In diesem Sinne erweist es sich als unerlässlich, unsere Kriterien auszuweiten, wenn wir politische Persönlichkeiten auswählen, um nicht auf falsche Idole hereinzufallen. Dieser Aufruf zu Vorsicht und einem besseren Unterscheidungsvermögen erscheint wie ein Imperativ, wenn wir die Unversehrbarkeit unserer demokratischen Prozesse und unserer Meinungsbildung wahren möchten.