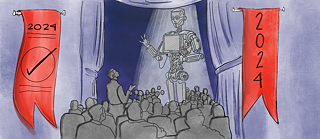

Le langage est capable d’envelopper les masses, mais les nouvelles technologies créent des masques persuasifs. Est-ce que nous sommes prêts à détecter la manipulation politique ?

En 2018, le régisseur et comédien américain Jordan Peele a créé une ingénieuse publicité intitulée « You Won’t Believe What Obama Says in This Video! » [Tu n’en reviendras pas ce qui Obama dit dans cette vidéo !]. Dans cette vidéo, Peele s’est fait passer pour l’ex-président Barack Obama avec l’aide d’une application d’intelligence artificielle (DeepFake). Tout simplement en imitant légèrement la voix d’Obama, il a réussi à construire une réalité fictive où l’ex-président diffamait et insultait ses opposants en moins d’une minute et demie. Le résultat fut tellement convaincant qu’il a généré une bonne quantité de commentaires, en confirmant ainsi la préoccupation du comédien : « Nous sommes dans une ère où nos ennemis peuvent faire que n’importe qui dit quoi que ce soit à tout moment… » La vidéo de Peele souligne que nous nous retrouvons à un moment dangereux où il est crucial de trouver des sources d’information fiables afin de contraster des opinions.

À la suite de cet événement a émergé la préoccupation d’explorer jusqu’à quel point les machines peuvent rivaliser avec notre libre arbitre. En 1950, Turing a créé un test qui évaluait la capacité des ordinateurs à répondre de façon semblable à l’intelligence humaine. Le test de Turing évalue si une machine peut se comporter intelligemment comme un être humain dans des conversations. Alan Turing a proposé que, si un évaluateur ne peut pas distinguer entre la machine et l’être humain dans une conversation textuelle, la machine passe le test. Au cours des dernières années, la vie s’est prêtée à la simulation, en donnant le coup d’envoi de diverses questions sur nos processus démocratiques.

Je me souviens du fait qu’au commencement des années 2000, des jeux vidéo comme The Sims ont commencé à expérimenter avec des avatars et des décisions simulées. Cependant surgit la question : qu’est-ce qui se passe quand dans les réalités numériques il y a des modèles à suivre avec la capacité d’exercer de l’influence au-delà de l’écran ? Suffit-il de se sentir compris pour modifier nos jugements et nos valeurs ?

Si l’on observe, d’un point de vue plus large, l’intelligence artificielle (IA) et la démocratie peuvent être en tension, surtout si nous considérons que les algorithmes utilisés dans la prise de décisions démocratiques peuvent être dessinés et ajustés par des entités externes. Cela soulève l’inquiétude que le manque de transparence dans ses opérations puisse saper la confiance du public. Nonobstant, la pensée collective et l’opinion publique sont façonnées significativement par des discours persuasifs et les points de vue sont constamment en débat en raison du manque de connaissances et d’exploration de diverses perspectives.

Selon les experts de l’Institut de technologie du Massachusetts (MIT, Massachusetts Institute of Technology), le secteur public et les institutions gouvernementales devraient considérer l’adoption d’outils comme Chatbot et ChatGPT. De plus, ils proposent la gestion de communautés par le biais d’avatars créés dans le métavers. Cela permettra que le processus d’apprentissage soit autonome, en stimulant le débat public et permettant la prise de décisions d’une manière directe, sans être influencé par les champs d’intérêt des entreprises ni des monopoles.

Populisme numérique

Décortiquer le mot « deep fake » ou « ultra faux » révèle l’essence du mensonge sous-jacente dans des vidéos qui, bien que fictifs, résultent de façon surprenante, si réalistes grâce à la manipulation avec des applications de l’IA. La propagation accélérée du faux contenu contraste avec la lenteur du développement d’outils efficaces pour le détecter. En outre, l’absence de régulations sur les droits de l’image ajoute une couche de complexité à ce phénomène.Le défi constant d’être soumis au « test de Turing » réside dans l’existence de formats d’intelligence artificielle que recréent des images et des voix de manière presque indiscernable de la réalité. Ces représentations, en tant que miroirs déformés de personnages, peuvent diffuser des messages avec des motivations cachées. Le deep fake se dresse comme un outil précis pour manipuler des émotions, en utilisant des messages subliminaux évoquant des sentiments tels quels la honte, la pitié, le dégoût, la mélancolie, le rejet ou l’adoration.

Ce phénomène défie notre capacité de discernement émotionnel, puisque, bien que les vidéos soient générées artificiellement, elles parviennent à provoquer des réponses émotionnelles authentiques. Le sens de communauté — construit dans de dialogues virtuels — peut élever des figures fictives ou sans pensées propres à des emplacements de pouvoir. D’un point de vue philosophique, est compréhensible l’inclinaison vers la croyance d’un être supérieur, mais l’analyse réflexive devient cruciale au moment où le discours est appliqué sur des personnalités populaires éphémères.

La société, en s’habituant à certains comportements, commence à mettre en évidence les manquements de ces personnalités populaires. En observant, les caractéristiques des leaders récents, certains parmi eux se distinguent par leur charisme, alors que d’autres sont rappelés par ses mauvais choix. Le populisme numérique se concentre sur le fait d’idolâtrer des personnalités créées et d’y suivre exclusivement par les réseaux sociaux ou par des interactions massives, ce qui encourage un système politique où la fidélité et la confiance sont difficiles à vérifier. Dans ce contexte, la politique ne se limite plus à influencer de petites portions ; ses implications atteignent la gouvernance de nations. La responsabilité incombe au fait de ne pas succomber à des ressources vides comme la polémique, le narcissisme, ou la radicalité, comme une évidence, dans le cas de Javier Milei en Argentine et ses discours qui répliquent à l’extrême droite à la recherche d’électeurs que le pousse vers la présidence de la République.

L’Union européenne reconnait la pertinence de ces vidéos comme des outils potentiels pour la désinformation. Dans ce scénario résulte impératif le fait d’élargir nos critères de sélection de personnalités politiques, en évitant ainsi de tomber dans le piège d’admirer de fausses idoles. Cet appel à la prudence et à un plus grand discernement se présente comme un impératif pour préserver l’intégrité de nos processus démocratiques et la formation de nos opinions.